AIGC的产业之路该如何走?

量子位智库 发自 凹非寺

量子位 | 公众号 QbitAI

AIGC(AI生成内容),这个概念最近可以说是火得一塌糊涂。

例如Stable Diffusion,只要对它说一句话,“唰唰唰”地就能秒生成画作:

Big chunky Venom(巨大敦实的毒液).

知名博主大谷Spitzer还用它“翻拍了”好莱坞国际巨星版的《华强买瓜》:

还有此前谷歌家的Imagen、OpenAI出的DALL·E系列等,也都成了备受网友们热捧的AI内容生成神器。

甚至还有人拿着Midjourney生成的画作参加艺术比赛,碾压人类夺得头筹,惹怒了一众艺术家

。

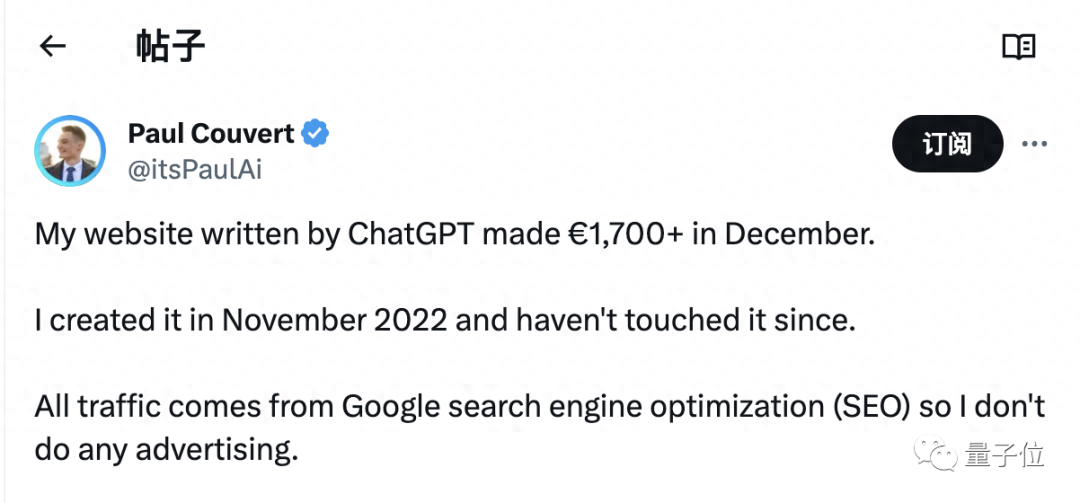

但正所谓“能用起来的技术才是好技术”,网友们将诸如此类AIGC技术热度推至的高度是对它实力的认可。

而此前市场还将项目发布仅一个月的Stable Diffusion背后公司估值为69亿元,这是资本对AIGC的肯定。

那么站在现在这个时间节点上,是时候对AIGC从技术发展路线、产业落地方向等多角度做一个梳理。

因此,量子位智库在进行深入调研之后正式发布《AIGC/AI生成内容产业展望报告》,核心回答三大问题:

- 在技术上,AIGC已经可以完成哪些创作?

- 在价值上,AIGC除了直接生成艺术作品还能做什么?

- 在未来,AIGC将如何改变内容及相关产业?

(完整报告获取方式见文末)

AIGC技术及八大场景应用

AIGC全称为AI-Generated Content,指基于生成对抗网络GAN、大型预训练模型等人工智能技术,通过已有数据寻找规律,并通过适当的泛化能力生成相关内容的技术。

与之相类似的概念还包括Synthetic media,合成式媒体, 主要指基于AI生成的文字、图像、音频等。

Gartner也提出了相似概念Generative AI,也即生成式AI。生成式AI是指该技术从现有数据中生成相似的原始数据。

相较于量子位智库认为的AIGC,这一概念的范围较狭窄。

我们认为,目前AIGC生成正在完成从简单的降本增效(以生成金融/体育新闻为代表)向创造额外价值(以提供绘画 创作素材为代表)转移,跨模态/多模态内容成为关键的发展节点。

技术视角下,我们认为以下场景将成为未来发展的重点:文本-图像-视频的跨模态生成、2D到3D生成、多模态理解 结合生成。

商业视角下,我们认为未来3年内,虚拟人生成和游戏AI这两种综合性的AIGC场景将趋于商业化成熟。

下图中的绿色部分,是我们认为2-3年内具有快速增长潜力的细分赛道。

文本生成

以结构性新闻撰写、内容续写、诗词创作等细分功能为代表,基于NLP技术的文本生成可以算作是AIGC中发展最早的一部分技术,也已经在新闻报道、对话机器人等应用场景中大范围商业落地。

从现有的落地场景来看,我们将其划分为应用型文本和创作型文本生成,前者的进展明显优于后者。此外,从应用推广的角度来说,辅助文本创作是目前落地最为广泛的场景。

应用型文本大多为结构化写作,以客服类的聊天问答、新闻撰写等为核心场景。主要玩家包括Automated Insights(美联社Wordsmith)、Narrative Science、textengine.io、AX Semantics、Yseop、Arria、retresco、Viable、澜舟科技等。同时也是小冰公司、腾讯、百度等综合性覆盖AIGC领域公司的重点布局领域。

创作型文本主要适用于剧情续写、营销文本等细分场景等,具有更高的文本开放度和自由度,需要一定的创意和个性化,对生成能力的技术要求更高。

代表性的国内外公司包括Anyword、Phrasee、Persado、Pencil、Copy.ai、 Friday.ai、Retresco、Writesonic、Conversion.ai、 Snazzy AI、Rasa.io、LongShot.AI、彩云小梦等。

除去端到端进行文本创作外,辅助文本写作其实是目前国内供给及落地最为广泛的场景。基本主要为基于素材爬取的协助作用,例如定向采集信息素材、文本素材预处理、自动聚类去重,并根据创作者的需求提供相关素材。

这部分的国内代表产品包括写作猫、Gilso写作机器人、Get写作、写作狐、沃沃AI人工智能写作。

图像生成

图像生成的传统思路是生成对抗网络(GAN),由生成器和判别器两部分组成,生成器将抓取数据、产生新的生成数据,并将其混入原始数据中送交判别器区分。

虽然说在现有的GAN在神经网络架构、损失函数设计、模型训练稳定性、模型崩溃问题上取得了相应突破,提升了最终图像的特定细节、内在逻辑、生成速度等。

但要在实际应用中大规模稳定应用,GAN仍需解决以下问题:训练不稳定、生成的样本大量重复、结构及压缩等问题。

2022年,Diffusion Model(扩散模型)成为图像生成领域的重要发现,甚至有超越GAN的势头。

相较于其他的图像生成模型(比如GAN、VAE和基于流的模型),在所需数据更少的背景下,Diffusion Model的图像生成效果有明显提升。

而在3D内容生成上,神经辐射场模型NeRF成为新一代模型。

NeRF通过将场景表示为隐式的神经辐射场,渲染时通过神经网络查询位置上的场景信息生成新视角图像。简单来说,NeRF利用深度学习完成了计算机图形学中的3D渲染任务。

基于对不同技术原理的梳理,我们将图像生成领域的技术场景划分为图像属性编辑、图像局部生成及更改、以及端到端的图像生成。

属性编辑部分,可以直观的将其理解为经AI降低门槛的PhotoShop。现有代表公司包括美图秀秀(美图AI开放平台)、Radius5、Photokit、Imglarger、Hotpot、Remove.bg、Skylum(Mask AI)、Photodiva。

图像部分编辑部分,指部分更改图像部分构成、修改面部特征。典型代表为选入CVPR2022的InsetGAN,该模型由Adobe推出。

图像端到端生成主要指基于草图生成完整图像、有机组合多张图像生成新图像、根据指定属性生成目标图像等。

该部分包含两类场景,分别为创意图像生成与功能性图像生成。前者大多以NPF等形式体现,后者则大多以营销类海报/界面、logo、模特图、用户头像为主。

垂直代表公司/产品包括Deepdream Generator、Rosebud.ai、AI Gahaku、artbreeder、nightcafe、starryai、wombo、deepart、obvious、阿里鹿班、ZMO.ai、Datagrid、诗云科技、道子智能绘画系统等。

音频生成

此类技术可应用于流行歌曲、乐曲、有声书的内容创作,以及视频、游戏、影视等领域的配乐创作,大大降低音乐版权的采购成本。

我们目前最为看好的场景是自动生成实时配乐、语音克隆以及心理安抚等功能性音乐的自动生成。

TTS(Text-to-speech)在AIGC领域下已相当成熟,广泛应用于客服及硬件机器人、有声读物制作、语音播报等任务。

目前技术上的的关键,在于如何通过富文本信息(如文本的深层情感、深层语义了解等)更好的表现其中的抑扬顿挫, 以及基于用户较少的个性化数据得到整体的复制能力(如小样本迁移学习)。

垂直代表公司包括倒映有声、科大讯飞、思必驰(DUI)、Readspeaker、DeepZen和Sonantic。

随着内容媒体的变迁,短视频内容配音已成为重要场景。部分软件能够基于文档自动生成解说配音,上线有150+款包括不同方言和音色的AI智能配音主播。代表公司有剪映、九锤配音、加音、XAudioPro等。

在TTS领域,语音克隆值得特别关注。该技术目前被应用于虚拟歌手演唱、自动配音等,在声音IP化的基础上,对于动画、电影、以及虚拟人行业有重要意义。

代表公司包括标贝科技、Modulate、overdub、replika、Replica Studios、Lovo、Voice mod、Resemble Ai、Respeecher、DeepZen、Sonantic、VoiceID 、Descript。

……

除此之外,因篇幅有限,更多AIGC落地细分场景可在文末获取完整报告进一步了解。

不过总体而言,我们认为,不同赛道下AIGC应用落地推广程度主要受到两方面影响,特定技术的水平状况以及在实际应用中出现的转化门槛。

并且以下技术要素值得关注:长文本生成、开放式文本生成、NeRF模型、Diffusion模型、跨模态大型预训练模型(支持的模态数据类型、模态对齐架构设计、支持的下游应用)、小样本学习及自监督算法、强化学习及环境学习。

技术场景方面,我们认为短期内将有较明显爆发的包括闲聊式文本生成、个性化营销文本、富情感及细节TTS、拼凑式视频生成、基于文本的AI绘画、语音复刻。

AIGC价值和产业发展分析

在量子位智库看来,用AI进行内容创作的价值主要 来源于五点。

区别于市场观点,我们认为最后一点,也即与AI系统的个性化、实时化互动最能体现其潜在价值。

尽管目前AIGC尚无法完成精准可控的生成,但我们相信这一赛道未来的技术与市场规模上限。

以下为五点主要价值,重要性逐次递增。

降低内容创作门槛,增加UGC用户群体

AIGC能够代替人工完成声音录制、图像渲染等工作,使更多人员能够参与到高价值的内容创作流程中。预计这一效果在2B结构化内容生成的领域非常明显,个别场景会出现2C服务。跨模态生成成为未来重点。

提升创作及反馈效率,铺垫线上实时互动

目前来看,效率提升主要体现在提升专业人员的生产效率。用户对于能够动态交互的个性化数字内容的需求越来越高,传统的开发方式无法满足日益上升的需求,消费速度远高于制作速度。需要AIGC填补供需间的差距。

但我们认为,更为关键的是,AI同样提升了内容的反馈生成速度,对于实时交互内容有重大意义,具有将线下和真人的快速交互迁移到线上的可能,也即令AI承担真人的社交、创作、协作功能,可能会出现新的潜在场景(如社交类和探索类游戏等)。

目前来看,内容消费者变得更容易将现实情感需求投射在虚拟世界中,预计会产生许多深入实时的互动需求,市场规模可观。

基于海量数据得到强创造性和开放性,有助于激发创意认知、提升内容生产多样性

相较于人类艺术家,AI能够接触借鉴更多的数据,在基于prompt进行内容生成后,AI创作的内容会有更多的二次创造空间和自由度。

例如,生成算法能基于特定条件或完全随机的生成现实中不存在的形状、色彩搭配、图案或结构等,赋予内容创作更多可能,产生“超现实感”及“未来感”,推动艺术创新。

对不同模态元素进行二次拆解组合,改变内容生产逻辑及形式

通过语音克隆、编曲风格提取等手段,AIGC能够将原客体所对应的不同模态信息进行拆解,例如演讲者的面部形象、 声音、演讲内容等。

在重新组合之后,能够完成过往受到条件限制无法完成的工作。例如路人的声音+专业的播音逻辑、 更符合特定审美的面部等,打破真人/真实场景在要素组合上具有的局限性。

和其他AI系统或数据库进行联动,有实现高度个性化/高频优化

在与特定的数据库(例如实时更新的客户数据、市场反馈数据、特定主题下的历史统计数据)或AI系统进行联动后(如个性化推荐系统等),AIGC能够在更为精准的未来预测/个性化预测基础上调整其生成内容。

例如,根据用户习惯调整内容营销文本、根据所处渠道风格调整生成内容、参考历史数据优化生成内容等。

产业链分析方面,由于我国的AIGC行业尚未发展成型,我们在此基于自身理解,绘制了产业链分布图。

目前,在上游,我国AIGC产业还有众多欠缺,以数据标注为重点体现。

我们认为,未来业务关联的大公司收购可能会成为主流现象,或应当存在较明显的大厂扩展业务趋势。但大厂的业务扩展动机往往在于通过新卖点快速 获取流量,优化核心业务,并不会过度关注AIGC本身业务价值的充分挖掘。

因此,在明确的新场景出来之前,我们认为这个行业更容易分散在不同的内容消费场景下。

我们所分析的行业门槛及核心竞争力:

- 无论是内容还是延展领域,在产品上最终需要回到一体化解决方案服务能力

- 回避大厂商后期的竞争压力

- 与行业的深度绑定关系

- 构建业务闭环

最后是我们基于此次调研所得出的六大关键结论:

完整报告可查看微信文章文末获取:

https://mp.weixin.qq.com/s/VQefNw_TX48mjfiR927NkQ

发评论,每天都得现金奖励!超多礼品等你来拿

登录 后,在评论区留言并审核通过后,即可获得现金奖励,奖励规则可见: 查看奖励规则