大模型搅局搜索,又热闹起来了

梦晨 衡宇 发自 凹非寺

量子位 | 公众号 QbitAI

AI大模型搅局搜索这事,又热闹起来了。

谷歌除了推出Bard,也开始在传统搜索上实验AI增强;微软必应悄悄增加GPT-4启用开关;创业公司Perplexity.ai也出了新版本。

国内方面,也出现一个新物种:首款AI搜索产品“天工AI搜索”,来自大模型黑马玩家昆仑万维。

如果不算大模型插件形式的实验,那么这就是国内首款正式落地,并投入应用的独立AI搜索产品了。

之前网友们预言的“搜索引擎给一页10个蓝蓝的链接,就像老式拨号电话的转盘一样成为历史”难道真的要应验了?柯达时刻既视感。

量子位第一时间参加了天工AI搜索的内测,实际体验了一波,玩起来和传统搜索体验确实大不一样——

就像是雇了一个助理在帮你资料,找完还给出总结汇报。

现在天工AI搜索也已经正式上线并开启内测申请(链接:tiangong.cn),大家可以尽情体验了。

AI搜索新物种

AI搜索这个新物种,一般长啥样?

以天工AI搜索为例,首页乍一看和普通搜索引擎似乎没什么不同。

试着搜索一些问题,才看到区别所在。

从推荐问题也可以看出,官方在有意引导用自然语言提问,不再需要用户自己去提炼关键词,想问什么就像问身边的人一样去问即可。

在展示搜索结果环节,传统搜索占主要篇幅的搜索结果,被压缩成了一小块“参考”。

只展示对回答这个问题有参考价值的筛选后结果,屏蔽了广告和低质量内容。

占页面正中C位的变成“回答”,也就是AI大模型根据问题和参考生成的内容了,经过AI整合提炼,避免了冗余无效信息,更高效和精准。

这部分也可以看出借鉴了AI聊天机器人应用,有反馈的点赞点踩按钮,一键复制,以及不满意可以重答。

再往下,大家熟悉的分页组件也不需要了。

取而代之的是“追问”,也就是AI预测接下来你还可能想问什么,点一下就可以继续延续上文聊下去。

这样将搜索引擎与大模型结合起来,有什么好处?

借助大模型的理解能力可以按整句分析用户的真实意图,而不是仅依赖于关键词匹配。

对于无法直接搜索到的内容,AI搜索也可以在理解的基础上作答。

还可以借助大模型的能力对搜索到的信息重新组织、整理、再按指定方式输出。

比如要对比两个事物的异同,AI搜索不光省去了筛选信息的过程,甚至可以一步到位直接让AI把搜索出来的结果绘制成表格,一目了然。

注意表格中每一句话后面都会附上来源,提供了信息溯源能力,解决了单纯的大模型生成内容大模型提供信息不容易验证的问题。

大模型的多轮对话能力也为搜索增加了新的玩法。

比如在学习一个思维模型时,不光可以让AI把方法介绍出来:

还可以通过继续“追问”这个话题,调动大模型对复杂问题的推理能力,回答“举例说明这个方法如何应用”这种开放式问题:

最后,AI搜索还可以从聊天机器人借鉴保存和分享对话记录。

在自己的搜索历史中再次搜索,可以解决“我上次搜出来一个什么但是忘记是怎么搜的了”这个问题。

为每一次搜索会话编上一个id,就可以分享出去,在不同设备查看,或者让其他人也看到同样的搜索结果,以及继续新的对话。

在试用中也发现一些有趣的现象,搜索结果不光影响AI生成的内容,还影响着AI生成的风格。

比如搜到的参考信息是繁体,AI容易也被带跑用了部分繁体字。

问专业性较强的问题,AI的回答也容易晦涩难懂。问日常生活问题,AI的回答又容易质量不高。

不过好在,大模型的那些提示工程技巧在这里同样适用。

看来AI搜索虽好,但要最大程度发挥其价值,就要去学习掌握大模型提示工程技巧了。

大模型+搜索,1+1>2

刚刚看到AI搜索的种种特点,都是借助大模型的能力才实现。

但这也不光是搜索从大模型身上得到好处,对于大模型来说,搜索同样是很好的增强和辅助。

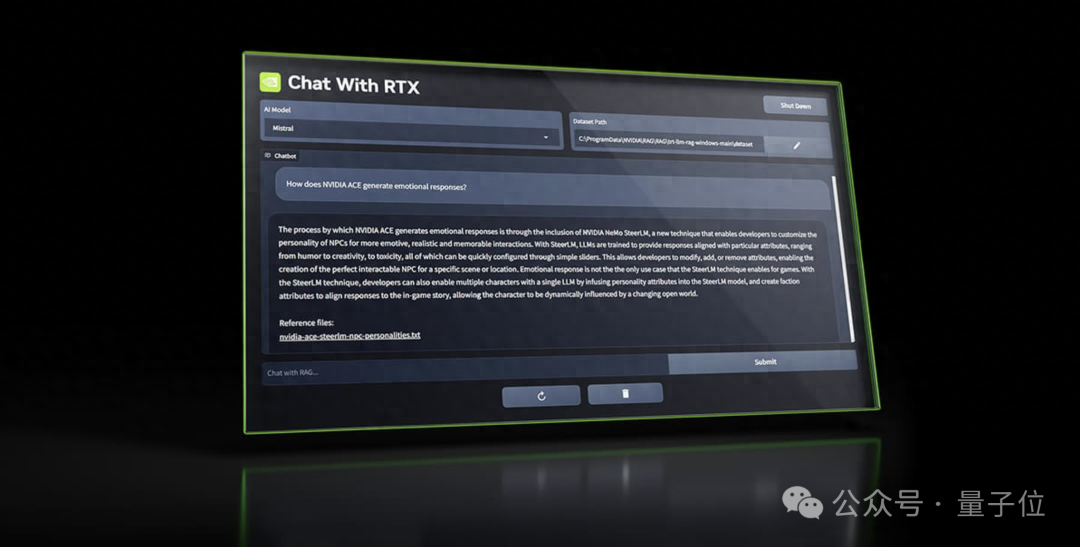

在AI研究界,近期一个热点就是检索增强生成(RAG,Retrieval Augmented Generation),用外部数据提高大模型回答问题的准确率、减少幻觉。

比直接用提示词提供上下文支持的数据量更多、质量更高,又比重新训练或微调大模型的成本低。

△来自fiddler.ai

一个经典用法是接入企业本地数据作为大模型的外部“知识库”。

大模型如果搜索到确切信息,自然就不用瞎编了,如果明确没搜索到结果,也更容易促使大模型答出“我不知道”。

在天工AI搜索测试中,也可以观察到互联网上搜索不到提问相关内容时回答“未搜索到”的情况。

AI搜索则是在此基础上更进一步,直接把整个互联网作为大模型的“知识库”。

具体来说,天工AI搜索使用了在处理长篇文档和复杂问题上具有天然优势的Dense Passage Retrieval(DPR)技术。

对问题和潜在相关文档(例如维基百科页面或论坛帖子)进行编码,并计算它们之间的相似度,确保准确无误地检索到与问题高度相关的文档及其关键段落。

同时,搜索引擎也能给训练数据固定的大模型提供最新的知识,保证生成方案的时效性。

比如大模型已经学到了各地景点的知识,但不知道未来几天的天气。

搜索补上这个缺口,就可以按照查到的天气信息有针对性的安排旅行计划。

在这个过程中,向量语义检索发挥了重要作用。

通过高维向量空间映射,排序系统能够快速筛选和定位网页中与用户问题最相关的段落,确保为大模型提供优质的信息输入。

再利用向量相似度算法,系统能够捕捉到内容间的微妙差异和多样性。这确保了传递给大模型的信息来源不仅是高度相关的,同时也保持了广泛的视角和维度,从而实现搜索结果的丰富性和深度。

最后通过召回用户之前查询的搜索结果,提高搜索结果与用户交互的连贯性,打造了一种更自然、流畅的搜索对话体验。

超级流量入口 or 个人智能助理

ChatGPT问世至今半年,行业逐渐达成了一个共识,即AI搜索确实是一个新的搜索范式。

它将搜索引擎与AI大模型结合,使搜索更加智能和人性化。

加上语义理解和多轮互动,让智能搜索不仅可以解析用户的搜索意图,还能根据上下文进行多轮提问,提供更精准的结果。

那么,这样一次重要的技术升级,能延展出什么新玩法?

昆仑万维作为局中人,给出了两种方向:

第一种,成为零成本、高效率的新一代生产力助手。

主要承担的任务,有材料收集、文案撰写、科研学习、智力外脑等功能。

沿着这条路线,未来AI搜索有可能作为互联网基础设施,以及超级流量入口的,最终形成新形态生产力工具的门户。

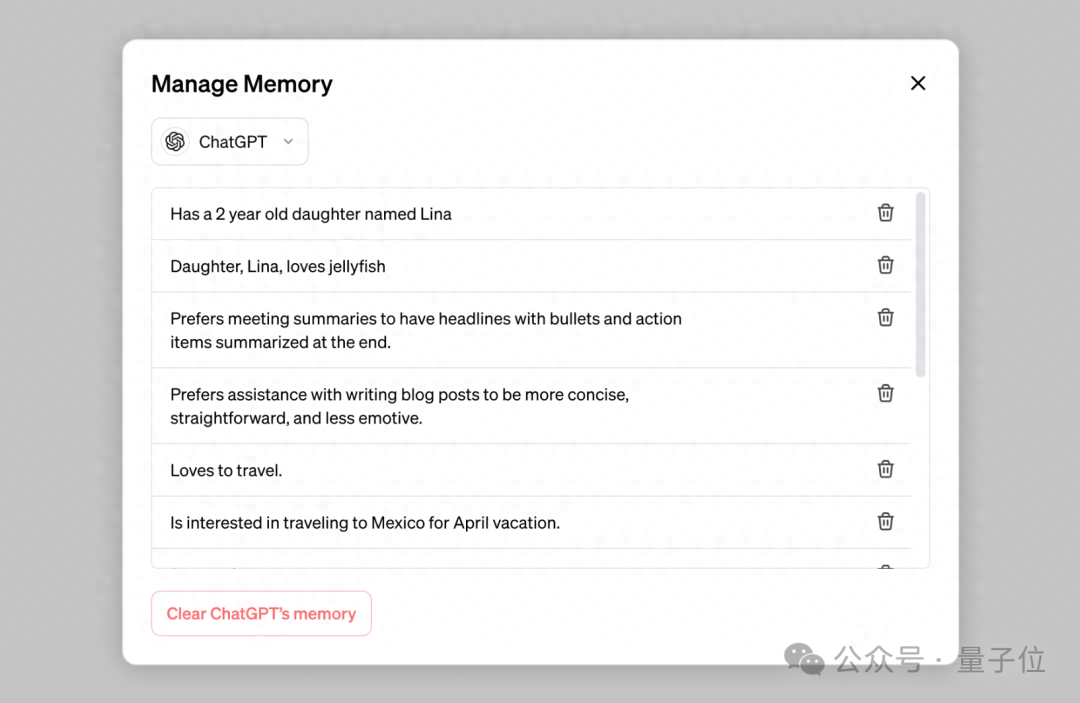

第二种,作为全天候私人管家。

基础版本的AI管家可以为用户的衣食住行提供个性化决策,并且妥善安排好日程。

进一步连锁,也可以在学习用户的偏好和习惯方向加强,提供更个性化的搜索体验,成为人手一个的个人助理。

言而总之,AI搜索产品这个形态,融合了大模型理解语义、记忆系统存储信息、以及交互工具与用户互动,和最近大火的AI智能体Agent天然适配。

“大模型+记忆+工具使用”这样的配置,距离OpenAI华人科学家翁丽莲给出的“配方”,也只差一步“主动规划”。

随着产品不断完善,未来可以在AI主动分解任务、缺少条件的时候AI可以主动反问用户等方向探索,如国外的Perplexity已经在往这方面探索。

而我们获悉,昆仑万维对AI搜索接下来的探索方向放在了大模型的另一个重要趋势:多模态。

除了文字,AI搜索可以集成图像、声音等多种输入方式,允许用户通过各种方式搜索信息。例如,用户可以上传一张植物的照片来查询它的名称和相关信息。

在传统搜索的文字搜文字,文字搜图、以图搜图之外,又能打开一个以图搜文字的新玩法维度。

AI搜索取得的这些进展,不禁让人想到万维网发明者Tim-Bernes Lee和那一辈先驱们的梦想:

在互联网实现人与人之间高效协作后,把机器引入进来与人交互,再次释放生产力。

为此他们提出改造整个互联网的“语义网”(Semantic Web)概念,在人能看懂的文字图片之外添加机器能看懂的元数据,实现信息和知识的发现、自动处理和重新组织,最终每个人都能拥有智能个人助理(Intelligent Personal Assistant)。

不过由于技术太复杂、工程规模太大等种种原因,这个梦想至今也没有完全实现。

兜兜转转近30年,大模型横空出世带来新的转机。

这一次人们不用去手动改造整个互联网了,而是AI通过机器学习去理解互联网中的知识,以及人们使用互联网的方式。

而AI搜索这个新物种,就是迈向智能个人助理的重要一步了。

看到这里,你打算如何利用AI搜索?期待未来人手一个的AI助理吗?

欢迎在评论区留言聊聊。

点击左下方“阅读原文”,申请加入“天工AI搜索”内测

天工AI搜索内测申请地址:

tiangong.cn

参考链接:

[1]https://www.fiddler.ai/blog/four-ways-that-enterprises-deploy-llms

发评论,每天都得现金奖励!超多礼品等你来拿

登录 后,在评论区留言并审核通过后,即可获得现金奖励,奖励规则可见: 查看奖励规则